Ce billet examine les développements et les lignes directrices en matière de réglementation de l'IA aux États-Unis, au Royaume-Uni, dans l'Union européenne et au Canada. En outre, nous examinerons l'impact de chaque réglementation sur le paysage de la gestion des risques des tiers.

La loi sur l'intelligence artificielle de l'Union européenne

Le 1er août 2024, la loi européenne sur l'IA est entrée en vigueur. Cette législation fait des régulateurs européens les premiers à disposer de lois complètes régissant l'IA générative et tout développement futur de l'IA. Il n'est pas inhabituel que l'Europe se trouve dans cette situation. En 2016, elle a été la première à se doter de règles complètes en matière de confidentialité des données avec le règlement général sur la protection des données (RGPD ). Avec la loi sur l'IA, l'Union européenne continue de jouer un rôle de premier plan dans le monde avec des réglementations exemplaires.

L 'Acte sur l'intelligence artificielle de l'Union européenne, officiellement le "Règlement du Parlement européen et du Conseil fixant des règles harmonisées en matière d'intelligence artificielle (Acte sur l'intelligence artificielle) et modifiant certains actes législatifs de l'Union", a été proposé à l'origine en 2021.

Les règles de cette loi sont conçues pour :

- Traiter les risques spécifiquement créés par les applications de l'IA ;

- Proposer une liste d'applications à haut risque ;

- Définir des exigences claires pour les systèmes d'IA destinés à des applications à haut risque ;

- Définir des obligations spécifiques pour les utilisateurs d'IA et les fournisseurs d'applications à haut risque ;

- Proposer une évaluation de la conformité avant que le système d'IA ne soit mis en service ou mis sur le marché ;

- Proposer des mesures d'exécution après la mise sur le marché d'un tel système d'intelligence artificielle ;

- Proposer une structure de gouvernance aux niveaux européen et national.

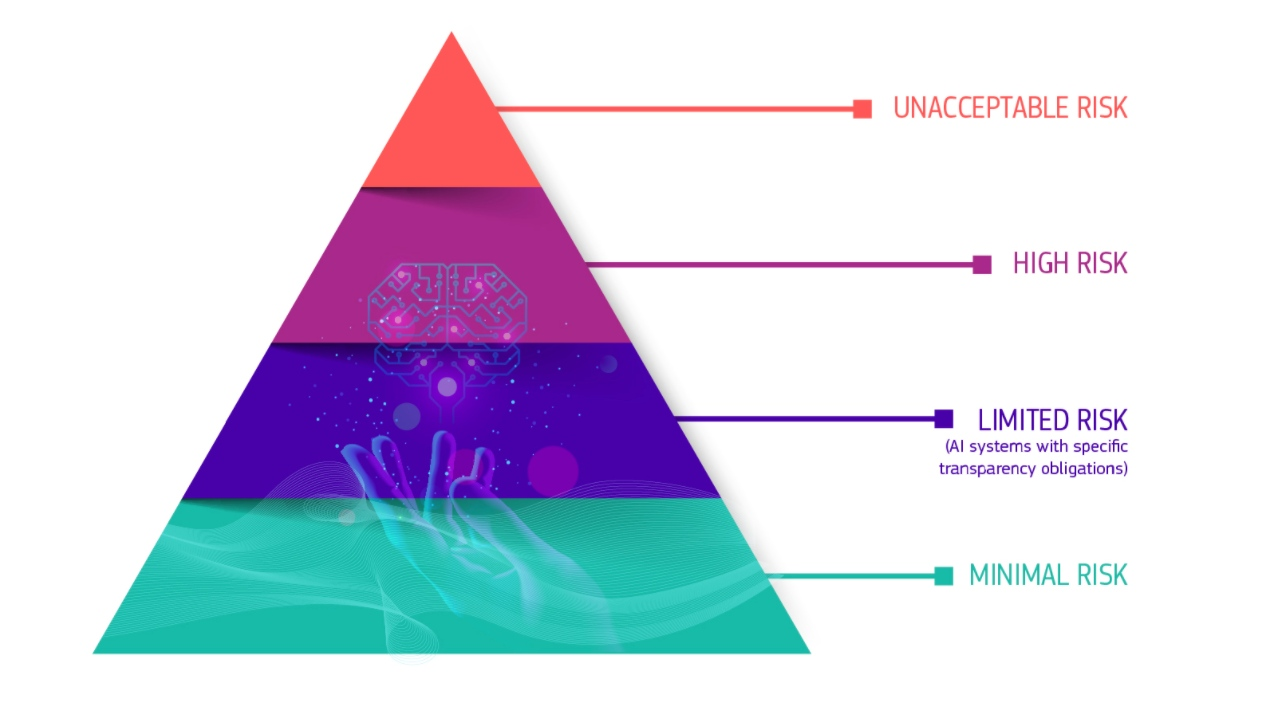

Le Parlement européen a adopté une approche du règlement basée sur les risques. Il a défini quatre catégories de risques, décrites à l'aide d'un modèle pyramidal, comme indiqué ci-dessous.

Ces quatre niveaux sont définis comme suit :

- Risque inacceptable - Ce niveau concerne les systèmes d'IA que l'UE considère comme une menace claire pour la sécurité, les moyens de subsistance et les droits des citoyens de l'UE. Deux exemples : la notation sociale par les gouvernements - qui semble interdire l'une des utilisations courantes de l'IA en Chine - et les jouets qui utilisent l'assistance vocale pour encourager un comportement dangereux.

- Risque élevé - Les systèmes d'IA à risque élevé sont ceux qui peuvent fonctionner dans des cas d'utilisation cruciaux pour la société. Il peut s'agir de l'IA utilisée dans l'accès à l'éducation, les pratiques d'emploi, l'application de la loi, le contrôle des frontières et l'immigration, les infrastructures critiques, l'accès à l'éducation et d'autres situations où les droits d'une personne pourraient être violés.

- Risque limité - Cette catégorie concerne les applications d'IA soumises à des obligations de transparence spécifiques. Pensez à un chatbot sur un site web. Dans ce cas précis, les consommateurs doivent savoir qu'ils interagissent avec un logiciel ou une machine, afin de pouvoir décider en connaissance de cause de s'engager ou non.

- Risque minimal - Également appelés "sans risque", ces systèmes d'IA sont utilisés dans des médias tels que les jeux vidéo ou les filtres anti-spam des courriels activés par l'IA. Il semble qu'il s'agisse là de l'essentiel de l'IA dans l'UE aujourd'hui.

Les systèmes d'IA à haut risque sont soumis à des règles spécifiques et strictes auxquelles ils doivent se conformer avant de pouvoir être commercialisés. D'après l'exposé de l'UE sur la loi sur l'IA, les systèmes à haut risque suivent ces règles :

- Des systèmes adéquats d'évaluation et d'atténuation des risques ;

- Haute qualité des ensembles de données alimentant le système afin de minimiser les risques et les résultats discriminatoires ;

- Enregistrement des activités pour assurer la traçabilité des résultats ;

- Documentation détaillée fournissant toutes les informations nécessaires sur le système et sa finalité pour que les autorités puissent évaluer sa conformité ;

- Des informations claires et adéquates pour l'utilisateur ;

- Des mesures de surveillance humaine appropriées pour minimiser les risques ;

- Niveau élevé de robustesse, de sécurité et de précision.

Tous les systèmes biométriques à distance, par exemple, sont considérés comme présentant un risque élevé. L'utilisation de la biométrie à distance dans les espaces publics à des fins d'identification (par exemple, la reconnaissance faciale) dans le cadre de l'application de la loi sera interdite en vertu de cette loi.

La loi sur l'IA établit un cadre juridique pour l'examen et l'approbation des applications d'IA à haut risque, dans le but de protéger les droits des citoyens, de minimiser les biais dans les algorithmes et de contrôler les impacts négatifs de l'IA.

Que signifie la loi européenne sur l'IA pour les programmes de gestion des risques des tiers ?

Les entreprises situées dans l'UE ou celles qui font des affaires avec des organisations de l'UE doivent être au courant des lois et s'y conformer après la période de préavis applicable. Compte tenu de la définition élargie de la notion de "risque élevé" dans la loi, il peut être judicieux de poser aux vendeurs et aux fournisseurs des questions plus concrètes sur la manière dont ils utilisent l'IA et sur la façon dont ils respectent les autres réglementations pertinentes.

Les organisations devraient également examiner en profondeur leurs propres pratiques de mise en œuvre de l'IA. D'autres lois européennes sur les technologies s'appliquent toujours, de sorte que les organisations qui doivent se conformer au GDPR devraient également explorer les moyens d'intégrer la conformité à la loi sur l'IA dans leur flux de travail.

Gouvernance de l'intelligence artificielle aux États-Unis

Bien qu'il n'existe actuellement aucune réglementation fédérale officielle en matière d'IA aux États-Unis, les organismes de normalisation ont publié de nombreuses orientations sous la forme de cadres de gouvernance et l'administration actuelle a récemment publié un mémorandum sur l'utilisation fédérale de l'IA, axé sur l'innovation, la gouvernance et la confiance du public. Entre-temps, de nombreuses juridictions à travers le pays ont proposé et promulgué des lois portant sur de multiples cas d'utilisation de l'IA.

Le cadre de gestion des risques liés à l'intelligence artificielle (AI RMF) du National Institute of Standards and Technology (NIST), introduit en janvier 2023, fournit une méthodologie pour élaborer une stratégie de gouvernance de l'IA au sein de votre organisation. Suivant ce cadre général, le NIST a publié le 26 juillet 2024 le document NIST-AI-600-1, Artificial Intelligence Risk Management Framework (Cadre de gestion des risques liés à l'intelligence artificielle) : Generative Artificial Intelligence Profile. Ce profil approfondit les risques distincts associés à l'IA générative et met en évidence les actions recommandées pour gérer ces risques en conformité avec le cadre de gestion des risques de l'IA.

Le RMF de l'IA du NIST et la gestion des risques par des tiers

Le cadre de l'IA du NIST offre des conseils sur l'élaboration d'une stratégie de gouvernance de l'IA dans votre organisation. Le RMF est divisé en deux parties. La première partie présente une vue d'ensemble des risques et des caractéristiques de ce que le NIST appelle les "systèmes d'IA dignes de confiance". La partie 2 décrit quatre fonctions pour aider les organisations à faire face aux risques des systèmes d'IA : Gouverner, Cartographier, Mesurer et Gérer. L'illustration ci-dessous passe en revue les quatre fonctions.

Les fonctions du cadre de gestion des risques liés à l'IA du NIST.

Les organisations doivent prendre en compte les principes de gestion des risques afin de minimiser les effets négatifs potentiels des systèmes d'IA, tels que les hallucinations, la confidentialité des données et les menaces pour les droits civils. Cette considération s'étend également à l'utilisation de systèmes d'IA de tiers ou à l'utilisation de systèmes d'IA par des tiers. Les risques potentiels d'une mauvaise utilisation de l'IA par des tiers sont les suivants :

- Vulnérabilités de sécurité dans l'application d'IA elle-même. En l'absence d'une gouvernance et de mesures de protection appropriées, votre organisation pourrait être exposée à une compromission du système ou des données.

- Manque de transparence dans les méthodologies ou les mesures des risques liés à l'IA. Les lacunes en matière de mesure et d'établissement de rapports pourraient entraîner une sous-estimation de l'impact des risques potentiels liés à l'IA.

- Les politiques de sécurité de l'IA qui ne sont pas cohérentes avec les autres procédures existantes de gestion des risques. Ces incohérences entraînent des audits compliqués et fastidieux qui pourraient avoir des conséquences négatives sur le plan juridique ou de la conformité.

Selon le NIST, le RMF aidera les organisations à surmonter ces risques potentiels.

Gouvernance de l'IA par l'État

En lieu et place de la législation fédérale, de nombreux États mettent en œuvre des réglementations relatives à l'intelligence artificielle. D'autres États, comme le Massachusetts, ont précisé comment leurs lois existantes s'appliquent aux développeurs, aux fournisseurs et aux utilisateurs de l'intelligence artificielle. Parmi les lois récemment adoptées par les États en matière de gouvernance de l'IA, citons l'AI Policy Act de l'Utah, qui est entré en vigueur en mai 2024, l'AI Act du Colorado (en vigueur en février 2026) et les lois californiennes AB 2013 et SB 942 (en vigueur en janvier 2026). Ces lois imposent une plus grande transparence dans la manière dont les systèmes d'IA sont développés et utilisés, exigent des informations claires pour les consommateurs et interdisent explicitement la discrimination algorithmique.

Parmi les thèmes communs, on peut citer

- Transparence et clarté des informations : Vérifier que nos fournisseurs divulguent clairement l'utilisation de l'IA et sont francs avec les consommateurs au sujet des décisions importantes basées sur l'IA.

- Équité et non-discrimination : Évaluer si les fournisseurs testent régulièrement les biais algorithmiques et y remédient.

- Documentation et évaluations d'impact : Exiger une documentation détaillée sur la conformité, y compris des ensembles de données sur la formation, des évaluations d'impact et des pratiques de protection des consommateurs.

- Protection des données: Mettre l'accent sur les contrôles de sécurité que les vendeurs doivent mettre en œuvre pour protéger les informations personnelles.

- Alignement réglementaire : Encourager les fournisseurs à s'aligner sur des normes reconnues (comme le cadre de gestion des risques liés à l'IA du NIST) pour favoriser la conformité.

Les réglementations nationales actuelles peuvent s'appliquer à l'intelligence artificielle

Le 16 avril 2024, le procureur général du Massachusetts a précisé que les lois existantes sur la protection des consommateurs s'appliquaient à l'IA. Les orientations mettent en garde contre les fausses affirmations concernant les capacités, la fiabilité ou la sécurité des systèmes d'IA et renforcent le respect des lois sur la protection de la vie privée et la lutte contre les discriminations. Elles mettent également l'accent sur les obligations de divulgation prévues par la loi sur l'égalité des chances en matière de crédit (Equal Credit Opportunity Act) lorsque l'IA est utilisée dans les décisions de crédit. Les gestionnaires de risques tiers doivent s'attendre à des tendances d'application similaires dans d'autres États et s'assurer que les outils d'IA des fournisseurs respectent les normes juridiques et éthiques.

Les équipes de gestion des risques doivent vérifier que les fournisseurs tiers indiquent clairement quand les clients interagissent avec l'IA, testent régulièrement leurs systèmes pour détecter les biais et se conforment à des règles strictes en matière de protection des consommateurs et de sécurité des données. L'utilisation de normes telles que le cadre de gestion des risques liés à l'IA du NIST peut contribuer à atténuer les risques de responsabilité dans le cadre de ces nouvelles réglementations.

Le projet de loi britannique sur la réglementation de l'intelligence artificielle

Au Royaume-Uni, Lord Holmes of Richmond a introduit un projet de loi sur l'égalité des chances pour les femmes et les hommes. Projet de loi sur la réglementation de l'IA à la Chambre des Lords. Il s'agit du deuxième projet de loi présenté au Parlement visant à réglementer l'utilisation de l'intelligence artificielle au Royaume-Uni. Le projet de loi projet de loi initial, portant à la fois sur l'IA et les droits des travailleurs, a été présenté à la Chambre des communes vers la fin de la session législative de 2022-2023, mais a été abandonné en mai 2023 en raison de la fin de la session.

Ce nouveau projet de loi sur l'IA, présenté en novembre 2023, a une portée plus large. Lord Holmes a introduit le règlement pour mettre des garde-fous autour du développement de l'IA et définir qui serait responsable de la définition des futures restrictions législatives sur l'IA au Royaume-Uni.

Le projet de loi, qui a été examiné en première lecture par la Chambre des Lords le 22 novembre 2023, présente quelques caractéristiques essentielles. Il s'agit notamment de

- La création d'une autorité de l'intelligence artificielle (AI Authority) chargée d'assurer une approche cohérente de l'intelligence artificielle au sein du gouvernement britannique. Elle est également chargée d'adopter une approche prospective de l'IA et de veiller à ce que tout cadre réglementaire futur s'aligne sur les cadres internationaux.

- La définition de principes réglementaires clés, qui met en place des garde-fous autour des réglementations que l'Autorité de l'IA proposée peut et doit créer. Selon le projet de loi, toute réglementation de l'IA mise en place doit respecter les principes de transparence, de responsabilité, de gouvernance, de sûreté, de sécurité, d'équité et de contestabilité. Le projet de loi précise également que les applications de l'IA doivent être conformes à la législation sur l'égalité, être inclusives dès leur conception et répondre aux besoins des "classes socio-économiques inférieures, des personnes âgées et des personnes handicapées".

- Définir la nécessité d'établir des "bacs à sable" réglementaires qui permettent aux régulateurs et aux entreprises de travailler ensemble pour tester efficacement les nouvelles applications de l'intelligence artificielle. Ces "bacs à sable" peuvent également offrir aux entreprises un moyen de comprendre et d'identifier les garanties appropriées pour les consommateurs afin de faire des affaires au Royaume-Uni.

- Plaidoyer pour la mise en place de responsables de l'IA dans chaque entreprise souhaitant faire des affaires au Royaume-Uni. Le rôle de ce responsable est de veiller à ce que toute application de l'IA dans l'entreprise soit aussi impartiale et éthique que possible, tout en s'assurant que les données utilisées dans l'IA restent impartiales.

- des lignes directrices sur la transparence, les obligations en matière de propriété intellectuelle et l'étiquetage, qui stipulent que les entreprises utilisant l'IA doivent fournir un relevé de toutes les données de tiers utilisées pour former leur modèle d'IA, respecter toutes les lois pertinentes en matière de propriété intellectuelle et de droits d'auteur, et indiquer clairement que leur logiciel utilise l'IA. Ce volet accorde également aux consommateurs le droit de refuser que leurs données soient utilisées pour former des modèles d'IA.

Cette proposition de règlement en est encore aux premières phases de négociation. Elle pourrait prendre une forme très différente après la deuxième lecture à la Chambre des Lords, suivie d'une lecture ultérieure à la Chambre des Communes.

En fonction de la partie du projet de loi qui survivra au processus législatif, il pourrait avoir un impact substantiel sur la façon dont l'IA est utilisée au Royaume-Uni, sur la façon dont les modèles sont formés et sur la transparence du processus de collecte de données au sens large. Chacun de ces domaines a un impact direct sur l'utilisation des technologies d'IA par les vendeurs ou les fournisseurs tiers.

Loi sur l'intelligence artificielle et les données (Canada)

En juin 2022, le gouvernement du Canada a commencé à examiner la loi sur l'intelligence artificielle et les données (AIDA) dans le cadre du projet de loi C-27, la loi de mise en œuvre de la Charte numérique, 2022. Le projet de loi C-27, plus vaste, est conçu pour moderniser la législation existante en matière de protection de la vie privée et de droit numérique. Il comprend trois sous-lois : la Loi sur la protection des renseignements personnels des consommateurs, la Loi sur l'intelligence artificielle et les données et la Loi sur le Tribunal de la protection des renseignements personnels et des données.

L'objectif principal de l'ACRA est de rendre plus cohérente la réglementation en matière d'IA dans l'ensemble du Canada. Quelques lacunes réglementaires ont été identifiées dans le document d'accompagnement de la loi :

- Des mécanismes tels que les commissions des droits de l'homme permettent de remédier aux cas de discrimination. Toutefois, les personnes victimes de préjugés liés à l'IA peuvent ne jamais en être conscientes.

- Compte tenu du large éventail d'utilisations des systèmes d'IA dans l'ensemble de l'économie, de nombreux cas d'utilisation sensibles ne relèvent pas des régulateurs sectoriels existants.

- Des normes minimales, une meilleure coordination et une plus grande expertise sont nécessaires pour assurer une protection cohérente des Canadiens dans tous les contextes d'utilisation.

La loi est actuellement en cours de discussion et le gouvernement canadien prévoit qu'il faudra environ deux ans pour qu'elle soit adoptée et mise en œuvre. Six principes fondamentaux ont été identifiés dans le document d'accompagnement de l'ACRA, présentés dans le tableau ci-dessous :

| Principe directeur | Comment AIDA le décrit | Ce que cela pourrait signifier pour le TPRM |

| Supervision et suivi humain | La surveillance humaine signifie que les systèmes d'IA à fort impact doivent être conçus et développés pour permettre aux personnes qui gèrent les opérations du système d'exercer une surveillance significative. Cela implique un niveau d'interprétabilité adapté au contexte.

Le suivi, par la mesure et l'évaluation des systèmes d'IA à fort impact et de leurs résultats, est essentiel pour soutenir une surveillance humaine efficace. |

Les vendeurs et les fournisseurs doivent mettre en place des méthodes facilement mesurables pour contrôler l'utilisation de l'IA dans leurs produits et leurs flux de travail.

Suite à l'adoption potentielle de l'ACRA, les organisations devront comprendre comment leurs tiers contrôlent l'utilisation de l'IA et intègrent l'IA dans leurs politiques plus larges de gouvernance et de surveillance. Un autre moyen d'assurer une supervision et un contrôle humains plus approfondis consiste à intégrer des examens humains dans les flux de travail des rapports afin de vérifier l'exactitude et la partialité. |

| Transparence | La transparence consiste à fournir au public des informations appropriées sur la manière dont les systèmes d'IA à fort impact sont utilisés.

Les informations fournies doivent être suffisantes pour permettre au public de comprendre les capacités, les limites et les impacts potentiels des systèmes. |

Les organisations devraient demander à leurs vendeurs et fournisseurs comment ils utilisent l'IA et quel type de données est inclus dans les modèles. Il convient également d'être attentif à la manière dont ces données sont intégrées. |

| Justice et équité | La justice et l'équité impliquent de construire des systèmes d'IA à fort impact en étant conscient du risque de résultats discriminatoires.

Des mesures appropriées doivent être prises pour atténuer les conséquences discriminatoires pour les individus et les groupes. |

Les organisations devraient s'enquérir de la manière dont les tiers contrôlent les biais potentiels dans leur utilisation de l'IA.

Il pourrait y avoir un impact supplémentaire en termes de nouvelles réglementations ESG nettes. |

| Sécurité | La sécurité signifie que les systèmes d'IA à fort impact doivent être évalués de manière proactive afin d'identifier les dommages qui pourraient résulter de l'utilisation du système, y compris en cas de mauvaise utilisation raisonnablement prévisible.

Des mesures doivent être prises pour atténuer le risque de préjudice. |

L'ACRA pourrait introduire de nouvelles réglementations concernant l'utilisation des données dans le contexte de l'IA.

Attendez-vous à de nouvelles exigences en matière de sécurité pour les outils d'IA et assurez-vous que les fournisseurs actuels et potentiels répondent aux questions sur la sécurité de leur utilisation de l'IA - y compris les contrôles de base tels que la sécurité des données, la gestion des actifs et la gestion des identités et des accès. |

| Responsabilité | La responsabilisation signifie que les organisations doivent mettre en place les mécanismes de gouvernance nécessaires pour garantir le respect de toutes les obligations légales des systèmes d'IA à fort impact dans le contexte dans lequel ils seront utilisés.

Cela comprend la documentation proactive des politiques, des processus et des mesures mises en œuvre. |

De nouvelles réglementations sont probables, ce qui incitera les entreprises à se renseigner auprès de tiers sur le respect des nouvelles exigences en matière de rapports et de mandats. |

| Validité et robustesse | La validité signifie qu'un système d'IA à fort impact fonctionne de manière cohérente avec les objectifs visés.

La robustesse signifie qu'un système d'IA à fort impact est stable et résilient dans diverses circonstances. |

Les organisations devraient interroger leurs tiers sur les éventuels problèmes de validité des modèles d'IA dans leurs opérations, une préoccupation qui peut concerner les fournisseurs de technologie et potentiellement s'étendre à la chaîne d'approvisionnement physique. |

En fin de compte, le gouvernement canadien examine attentivement la manière de réglementer l'utilisation de l'IA à l'échelle nationale. Quoi qu'il en soit, il y aura de nouveaux mandats et de nouvelles lois à respecter. Il est donc logique que les entreprises qui font des affaires au Canada ou qui travaillent avec des entreprises canadiennes comprennent les exigences à venir au fur et à mesure que l'ACRA se rapproche de son adoption.

Dernières réflexions : Réglementation de l'IA et gestion des risques liés aux tiers

Les gouvernements du monde entier débattent activement de la manière de réglementer la technologie de l'intelligence artificielle et son développement. Les discussions sur la réglementation se sont concentrées sur des cas d'utilisation spécifiques identifiés comme étant potentiellement les plus impactants au niveau sociétal, suggérant que les lois sur l'IA aborderont une combinaison de préoccupations relatives à la vie privée, à la sécurité et à l'ESG.

Nous voyons rapidement comment les organisations du monde entier doivent adapter leurs programmes de gestion des risques de tiers à la technologie de l'IA. Les entreprises intègrent rapidement l'IA dans leurs opérations, et les gouvernements réagiront en conséquence. À ce stade, adopter une approche plus prudente et réfléchie de l'IA dans les opérations et poser des questions aux vendeurs et aux fournisseurs est le bon choix pour les gestionnaires de risques tiers.

Pour en savoir plus sur la façon dont Mitratech intègre les technologies de l'IA dans ses solutions de gestion des risques des tiers afin de garantir la transparence, la gouvernance et la sécurité, téléchargez le livre blanc Comment exploiter la puissance de l'IA dans la gestion des risques des tiers ou demandez une démonstration dès aujourd'hui.

Note de l'éditeur : cet article a été publié à l'origine sur Prevalent.net. En octobre 2024, Mitratech a fait l'acquisition de la société Prevalent, spécialisée dans la gestion des risques liés aux tiers et basée sur l'IA. Le contenu a depuis été mis à jour pour inclure des informations alignées sur nos offres de produits, les changements réglementaires et la conformité.