En este artículo examinaremos las novedades y directrices normativas sobre IA de Estados Unidos, el Reino Unido, la Unión Europea y Canadá. Además, analizaremos el impacto de cada normativa en el panorama de la gestión de riesgos de terceros.

La Ley de Inteligencia Artificial de la Unión Europea

El 1 de agosto de 2024 entró en vigor la Ley de IA de la UE. Esta legislación convierte a los reguladores europeos en los primeros en tener leyes integrales que regulan la IA generativa y cualquier desarrollo futuro de IA. No es algo inusual en Europa. En 2016, fueron los primeros en tener normas integrales de privacidad de datos con el Reglamento General de Protección de Datos (RGPD ). La Ley de IA marca la continuación del liderazgo mundial del bloque con normativas ejemplares.

La Ley de Inteligencia Artificial de la Unión Europea, oficialmente el "Reglamento del Parlamento Europeo y del Consejo por el que se establecen normas armonizadas sobre la inteligencia artificial (Ley de Inteligencia Artificial) y se modifican determinados actos legislativos de la Unión", se propuso originalmente en 2021.

Las normas de esta ley tienen por objeto:

- Abordar los riesgos creados específicamente por las aplicaciones de IA;

- Proponer una lista de aplicaciones de alto riesgo;

- Establecer requisitos claros para los sistemas de IA para aplicaciones de alto riesgo;

- Definir obligaciones específicas para los usuarios de IA y los proveedores de aplicaciones de alto riesgo;

- Proponer una evaluación de la conformidad antes de que el sistema de IA se ponga en servicio o se comercialice;

- Proponer medidas coercitivas tras la comercialización de un sistema de IA de este tipo;

- Proponer una estructura de gobernanza a escala europea y nacional.

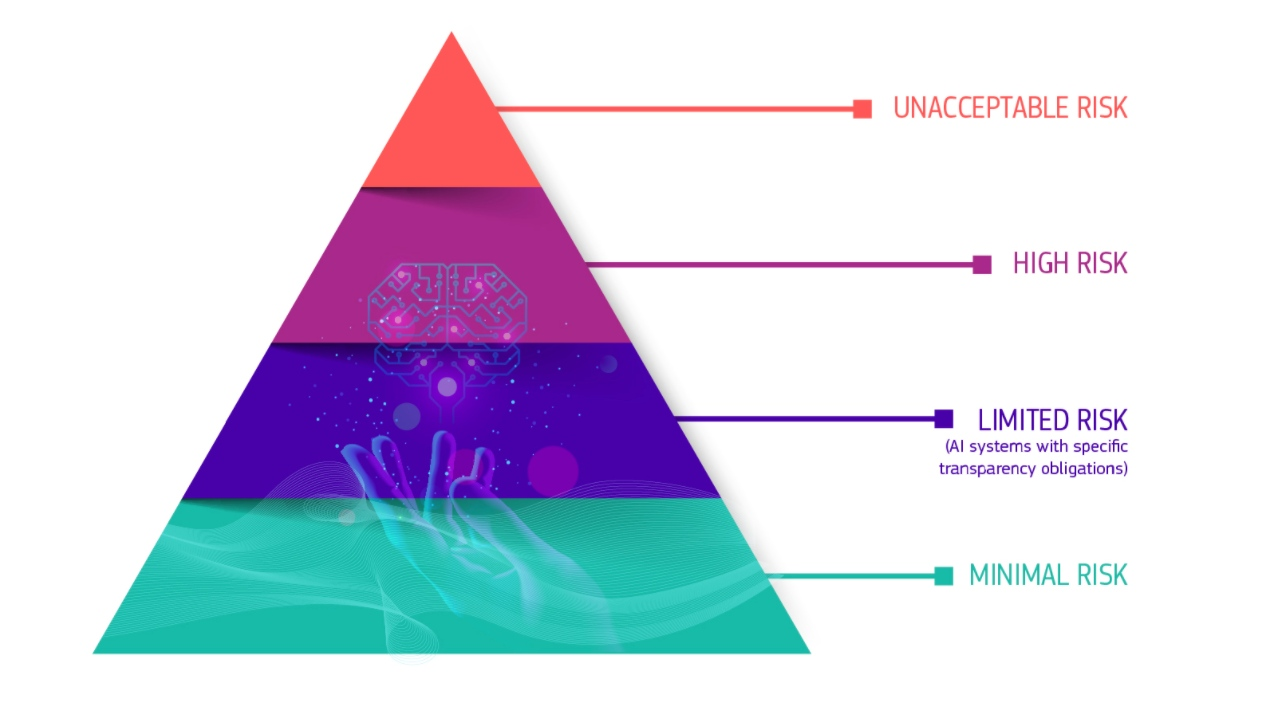

El Parlamento Europeo adoptó un enfoque de la normativa basado en el riesgo. Definió cuatro categorías de riesgo, esbozadas mediante un modelo piramidal como el que se muestra a continuación.

Estos cuatro niveles se definen como:

- Riesgo inaceptable: este nivel se refiere a cualquier sistema de IA que la UE considere una amenaza clara para la seguridad, los medios de vida y los derechos de los ciudadanos de la UE. Dos ejemplos son la puntuación social por parte de los gobiernos -que parece prohibir uno de los usos habituales de la IA en China- y los juguetes que utilizan la asistencia por voz para fomentar comportamientos peligrosos.

- Alto riesgo - Los sistemas de IA marcados como de alto riesgo son aquellos que pueden operar en casos de uso cruciales para la sociedad. Esto puede incluir la IA utilizada en el acceso a la educación, las prácticas de empleo, la aplicación de la ley, el control de fronteras y la inmigración, las infraestructuras críticas, el acceso a la educación y otras situaciones en las que podrían vulnerarse los derechos de alguien.

- Riesgo limitado - Esta categoría se refiere a las aplicaciones de IA con obligaciones específicas de transparencia. Piense en un chatbot en un sitio web. En ese caso concreto, los consumidores deben ser conscientes de que están interactuando con un programa de software o una máquina, para que puedan tomar decisiones informadas sobre si participar o no.

- Riesgo mínimo - También llamados "sin riesgo", son sistemas de IA utilizados en medios como videojuegos o filtros de spam de correo electrónico con IA. Esta parece ser la mayor parte de la IA en la UE hoy en día.

Los sistemas de IA de alto riesgo tienen normas específicas y estrictas que deben cumplir antes de poder salir al mercado. Según el texto de la UE sobre la Ley de IA, los sistemas de alto riesgo siguen estas normas:

- Sistemas adecuados de evaluación y mitigación de riesgos;

- Alta calidad de los conjuntos de datos que alimentan el sistema para minimizar los riesgos y los resultados discriminatorios;

- Registro de la actividad para garantizar la trazabilidad de los resultados;

- Documentación detallada que proporcione toda la información necesaria sobre el sistema y su finalidad para que las autoridades puedan evaluar su conformidad;

- Información clara y adecuada al usuario;

- Medidas adecuadas de supervisión humana para minimizar el riesgo;

- Alto nivel de solidez, seguridad y precisión.

Todos los sistemas biométricos remotos, por ejemplo, se consideran de alto riesgo. El uso de biometría remota en espacios públicos para la identificación (por ejemplo, reconocimiento facial) en las fuerzas del orden estará prohibido en virtud de esta ley.

La Ley de IA establece un marco jurídico para revisar y aprobar las aplicaciones de IA de alto riesgo, con el objetivo de proteger los derechos de los ciudadanos, minimizar los sesgos en los algoritmos y controlar los impactos negativos de la IA.

¿Qué significa la Ley de IA de la UE para los programas de gestión de riesgos de terceros?

Las empresas ubicadas en la UE o las que hacen negocios con organizaciones de la UE deben conocer y cumplir la legislación tras el periodo de notificación aplicable. Dada la amplia definición de "alto riesgo" de la ley, puede tener sentido plantear a los vendedores y proveedores preguntas más concretas sobre cómo utilizan la IA y cómo cumplen el resto de la normativa pertinente.

Las organizaciones también deben examinar a fondo sus propias prácticas de implementación de IA. Todavía se aplican otras leyes tecnológicas europeas, por lo que las organizaciones que necesiten cumplir el GDPR también deben explorar formas de integrar el cumplimiento de la Ley de IA en su flujo de trabajo.

Gobernanza de la Inteligencia Artificial en Estados Unidos

Aunque en la actualidad no existe ninguna normativa federal oficial sobre IA en Estados Unidos, los organismos de normalización han publicado amplias orientaciones en forma de marcos de gobernanza, y la administración actual ha publicado recientemente un memorando sobre el uso federal de la IA, centrado en la innovación, la gobernanza y la confianza pública. Mientras tanto, numerosas jurisdicciones de todo el país han propuesto y promulgado leyes que abordan múltiples casos de uso de la IA.

El marco de gestión de riesgos de la IA (AI RMF) del Instituto Nacional de Normas y Tecnología (NIST), presentado en enero de 2023, proporciona una metodología para elaborar una estrategia de gobernanza de la IA dentro de su organización. Siguiendo este marco general, el 26 de julio de 2024, el NIST publicó NIST-AI-600-1, Artificial Intelligence Risk Management Framework: Perfil de Inteligencia Artificial Generativa. Este perfil profundiza en los distintos riesgos asociados a la IA generativa y destaca las acciones recomendadas para gestionar esos riesgos en consonancia con el RMF de IA.

El NIST AI RMF y la gestión de riesgos de terceros

El marco de IA del NIST ofrece orientación para elaborar una estrategia de gobernanza de la IA en su organización. El RMF se divide en dos partes. La Parte 1 incluye una visión general de los riesgos y características de lo que el NIST denomina "sistemas de IA fiables". La Parte 2 describe cuatro funciones para ayudar a las organizaciones a abordar los riesgos de los sistemas de IA: Gobernar, Mapear, Medir y Gestionar. La siguiente ilustración repasa las cuatro funciones.

Las funciones del marco de gestión de riesgos de IA del NIST.

Las organizaciones deben tener en cuenta los principios de gestión de riesgos para minimizar los posibles impactos negativos de los sistemas de IA, como la alucinación, la privacidad de los datos y las amenazas a los derechos civiles. Esta consideración también se extiende al uso de sistemas de IA de terceros o al uso de sistemas de IA por parte de terceros. Los riesgos potenciales del uso indebido de la IA por parte de terceros incluyen:

- Vulnerabilidades de seguridad en la propia aplicación de IA. Sin la gobernanza y las salvaguardas adecuadas, su organización podría verse expuesta a un compromiso del sistema o de los datos.

- Falta de transparencia en las metodologías o mediciones del riesgo de IA. Las deficiencias en la medición y presentación de informes podrían dar lugar a una subestimación del impacto de los posibles riesgos de IA.

- Políticas de seguridad de la IA incoherentes con otros procedimientos de gestión de riesgos existentes. La incoherencia da lugar a auditorías complicadas y que requieren mucho tiempo, lo que podría acarrear posibles consecuencias negativas desde el punto de vista jurídico o del cumplimiento normativo.

Según el NIST, el RMF ayudará a las organizaciones a superar estos riesgos potenciales.

Gobernanza estatal de la IA

En lugar de la legislación federal, muchos Estados están aplicando normativas sobre inteligencia artificial. Otros estados, como Massachusetts, han aclarado cómo se aplican sus leyes vigentes a los desarrolladores, proveedores y usuarios de inteligencia artificial. Entre las leyes estatales sobre gobernanza de la IA promulgadas recientemente figuran la Ley de Política de IA de Utah, que entró en vigor en mayo de 2024, la Ley de IA de Colorado (en vigor en febrero de 2026) y las leyes AB 2013 y SB 942 de California (en vigor en enero de 2026). Estas leyes obligan a una mayor transparencia en la forma en que se desarrollan y utilizan los sistemas de IA, exigen información clara al consumidor y prohíben explícitamente la discriminación algorítmica.

Algunos temas comunes son:

- Transparencia e información clara: Verificar que nuestros proveedores revelan claramente el uso de la IA y son francos con los consumidores sobre las decisiones importantes basadas en la IA.

- Equidad y no discriminación: Evalúe si los proveedores comprueban y abordan regularmente los sesgos algorítmicos.

- Documentación y evaluaciones de impacto: Exigir documentación detallada sobre el cumplimiento, incluidos conjuntos de datos de formación, evaluaciones de impacto y prácticas de protección de los consumidores.

- Protección de datos: Hacer hincapié en los controles de seguridad que los vendedores deben aplicar para proteger la información personal.

- Alineación normativa: Anime a los proveedores a alinearse con las normas reconocidas (como el Marco de Gestión de Riesgos de IA del NIST) para apoyar el cumplimiento.

La normativa estatal vigente puede aplicarse a la inteligencia artificial

El 16 de abril de 2024, el fiscal general de Massachusetts aclaró que las leyes vigentes de protección del consumidor se aplican a la IA. La guía advierte contra las afirmaciones falsas sobre las capacidades, fiabilidad o seguridad de los sistemas de IA y refuerza el cumplimiento de las leyes de privacidad y antidiscriminación. También destaca los requisitos de divulgación en virtud de la Ley de Igualdad de Oportunidades de Crédito cuando la IA se utiliza en las decisiones crediticias. Los gestores de riesgos de terceros deben esperar tendencias de aplicación similares en otros estados y asegurarse de que las herramientas de IA de los proveedores cumplen las normas legales y éticas.

Los equipos de gestión de riesgos deben verificar que los proveedores externos informen claramente cuando los clientes interactúan con la IA, prueben regularmente sus sistemas para detectar sesgos y cumplan las estrictas normas de protección de los consumidores y de seguridad de los datos. El uso de normas como el Marco de Gestión de Riesgos de IA del NIST puede ayudar a mitigar los riesgos de responsabilidad derivados de estas nuevas normativas.

Proyecto de ley sobre la regulación de la inteligencia artificial en el Reino Unido

En el Reino Unido, Lord Holmes de Richmond introdujo una Proyecto de ley sobre la regulación de la IA en la Cámara de los Lores. Se trata del segundo proyecto de ley presentado en el Parlamento para regular el uso de la inteligencia artificial en el Reino Unido. El sitio factura inicial, que aborda tanto la IA como los derechos de los trabajadores, se presentó en la Cámara de los Comunes hacia la conclusión de la sesión legislativa de 2022 a 2023, pero se interrumpió en mayo de 2023 debido a la conclusión de la sesión.

Este nuevo proyecto de ley sobre IA, presentado en noviembre de 2023, tiene un enfoque más amplio. Lord Holmes introdujo la normativa para poner algunos límites al desarrollo de la IA y definir quién sería el responsable de definir las futuras restricciones legislativas sobre la IA en el Reino Unido.

Hay algunas características clave del proyecto de ley, que tuvo su primera lectura en la Cámara de los Lores el 22 de noviembre de 2023. Entre ellas:

- La creación de una Autoridad de Inteligencia Artificial encargada de garantizar un enfoque coherente de la inteligencia artificial en todo el gobierno del Reino Unido. También se encargará de adoptar un enfoque prospectivo de la IA y de garantizar que cualquier marco regulador futuro se ajuste a los marcos internacionales.

- La definición de los principios reguladores clave, que pone límites a la normativa que la Autoridad de la IA propuesta puede y debe crear. Según el proyecto de ley, toda normativa sobre IA debe respetar los principios de transparencia, responsabilidad, gobernanza, seguridad, equidad e impugnabilidad. El proyecto de ley también señala que las aplicaciones de IA deben cumplir la legislación sobre igualdad, ser inclusivas por diseño y satisfacer las necesidades de "las clases socioeconómicas más bajas, las personas mayores y los discapacitados".

- Definir la necesidad de establecer "cajones de arena" normativos que permitan a los reguladores y a las empresas trabajar juntos para probar eficazmente las nuevas aplicaciones de la inteligencia artificial. Estos "cajones de arena" también pueden ofrecer a las empresas una forma de comprender y precisar las salvaguardias adecuadas para los consumidores a la hora de hacer negocios en el Reino Unido.

- Abogar por que haya responsables de IA en todas las empresas que quieran hacer negocios en el Reino Unido. La función de este responsable es garantizar que cualquier aplicación de la IA en la empresa sea lo más imparcial y ética posible, asegurando al mismo tiempo que los datos utilizados en la IA sigan siendo imparciales.

- Directrices sobre transparencia, obligaciones de propiedad intelectual y etiquetado, que estipulan que las empresas que utilicen IA proporcionen un registro de todos los datos de terceros utilizados para entrenar su modelo de IA, cumplan todas las leyes pertinentes de propiedad intelectual y derechos de autor, y etiqueten claramente su software como que utiliza IA. Este componente también concede a los consumidores el derecho a optar por que no se utilicen sus datos para entrenar modelos de IA.

Esta propuesta de reglamento se encuentra aún en las primeras fases de negociación. Podría adoptar una forma muy diferente tras la segunda lectura en la Cámara de los Lores, seguida de una lectura posterior en la Cámara de los Comunes.

Dependiendo de qué parte del proyecto de ley sobreviva al proceso legislativo, podría tener un impacto sustancial en cómo se utiliza la IA en el Reino Unido, cómo se entrenan los modelos y la transparencia del proceso más amplio de recopilación de datos. Cada una de estas áreas tiene un impacto directo en el uso de las tecnologías de IA por parte de terceros vendedores o proveedores.

Ley de Inteligencia Artificial y Datos (Canadá)

En junio de 2022, el gobierno de Canadá empezó a estudiar la Ley de Inteligencia Artificial y Datos (AIDA) como parte del proyecto de ley C-27, la Ley de Aplicación de la Carta Digital de 2022. El proyecto de ley C-27 está diseñado para modernizar la legislación digital y de privacidad existente. Incluye tres subleyes: la Ley de Protección de la Privacidad de los Consumidores, la Ley de Inteligencia Artificial y Datos, y la Ley del Tribunal de Información Personal y Protección de Datos.

El principal objetivo de la AIDA es aportar coherencia a la normativa sobre IA en todo Canadá. En el documento complementario de la Ley se señalan algunas lagunas normativas, como:

- Mecanismos como las comisiones de derechos humanos ofrecen reparación en casos de discriminación. Sin embargo, es posible que las personas sometidas a prejuicios de AI nunca sean conscientes de que se han producido.

- Dada la amplia gama de usos de los sistemas de IA en toda la economía, muchos casos de uso sensibles no entran en el ámbito de los reguladores sectoriales existentes.

- Se necesitan normas mínimas, una mayor coordinación y conocimientos especializados para garantizar una protección coherente de los canadienses en todos los contextos de uso.

La ley se está debatiendo en la actualidad y el gobierno canadiense prevé que se tardará aproximadamente dos años en aprobarla y aplicarla. En el documento complementario de AIDA se identifican seis principios básicos, que se resumen en el cuadro siguiente:

| Principio rector | Cómo lo describe AIDA | Lo que podría significar para el TPRM |

| Supervisión y control humanos | Supervisión humana significa que los sistemas de IA de alto impacto deben diseñarse y desarrollarse para permitir que las personas que gestionan las operaciones del sistema ejerzan una supervisión significativa. Esto incluye un nivel de interpretabilidad adecuado al contexto.

La supervisión, mediante la medición y evaluación de los sistemas de IA de alto impacto y sus resultados, es fundamental para apoyar una supervisión humana eficaz. |

Los vendedores y proveedores deben establecer métodos fácilmente medibles para supervisar el uso de la IA en sus productos y flujos de trabajo.

Tras la posible aprobación de la AIDA, las organizaciones tendrán que entender cómo sus terceros supervisan el uso de la IA e incorporarla a sus políticas más amplias de gobernanza y supervisión. Otra forma de garantizar una supervisión y un control humanos más exhaustivos es incorporar revisiones humanas a los flujos de trabajo de elaboración de informes para comprobar la exactitud y la parcialidad. |

| Transparencia | Transparencia significa proporcionar al público información adecuada sobre cómo se utilizan los sistemas de IA de alto impacto.

La información facilitada debe ser suficiente para que el público comprenda las capacidades, limitaciones e impactos potenciales de los sistemas. |

Las organizaciones deberían preguntar a sus vendedores y proveedores cómo utilizan la IA y qué tipo de datos se incluyen en los modelos. Tenga en cuenta también cómo se integran. |

| Justicia y equidad | Imparcialidad y equidad significa crear sistemas de IA de alto impacto teniendo en cuenta la posibilidad de que se produzcan resultados discriminatorios.

Deben tomarse medidas adecuadas para mitigar los resultados discriminatorios para individuos y grupos. |

Las organizaciones deben informarse de cómo controlan los terceros los posibles sesgos en el uso de la IA.

Aquí podría haber un impacto adicional en términos de nuevas regulaciones netas ESG. |

| Seguridad | La seguridad significa que los sistemas de IA de alto impacto deben evaluarse de forma proactiva para identificar los daños que podrían derivarse del uso del sistema, incluso a través de un mal uso razonablemente previsible.

Deben tomarse medidas para mitigar el riesgo de daños. |

AIDA puede introducir nuevas normas sobre el uso de datos en el contexto de la IA.

Espere nuevos requisitos de seguridad en las herramientas de IA y asegúrese de que los proveedores actuales y potenciales respondan a las preguntas sobre la seguridad de su uso de la IA, incluidos controles básicos como la seguridad de los datos, la gestión de activos y la gestión de identidades y accesos. |

| Rendición de cuentas | Rendir cuentas significa que las organizaciones deben poner en marcha los mecanismos de gobernanza necesarios para garantizar el cumplimiento de todas las obligaciones legales de los sistemas de IA de alto impacto en el contexto en el que se vayan a utilizar.

Esto incluye la documentación proactiva de las políticas, procesos y medidas aplicadas. |

Es probable que surjan nuevas normativas, lo que impulsará a las empresas a informarse con terceros sobre el cumplimiento de los nuevos requisitos y mandatos de información. |

| Validez y solidez | Validez significa que un sistema de IA de alto impacto funciona de forma coherente con los objetivos previstos.

Robustez significa que un sistema de IA de alto impacto es estable y resistente en diversas circunstancias. |

Las organizaciones deben preguntar a sus terceros sobre cualquier problema de validez de los modelos de IA en sus operaciones, una preocupación que puede ser relevante para los proveedores de tecnología y extenderse potencialmente a la cadena de suministro física. |

En última instancia, el gobierno canadiense está estudiando detenidamente cómo regular el uso de la IA en todo el país. Habrá nuevos mandatos y leyes que cumplir pase lo que pase. Por lo tanto, tiene sentido que las empresas que hacen negocios en Canadá o que trabajan con empresas canadienses entiendan los próximos requisitos a medida que AIDA se acerca a su aprobación.

Reflexiones finales: Normativa sobre IA y gestión de riesgos de terceros

Los gobiernos de todo el mundo están debatiendo activamente cómo regular la tecnología de inteligencia artificial y su desarrollo. Los debates regulatorios se han centrado en casos de uso específicos identificados como potencialmente los más impactantes a nivel social, lo que sugiere que las leyes de IA abordarán una combinación de preocupaciones de privacidad, seguridad y ESG.

Estamos viendo rápidamente cómo las organizaciones de todo el mundo deben adaptar sus programas de gestión de riesgos de terceros a la tecnología de IA. Las empresas están integrando rápidamente la IA en sus operaciones, y los gobiernos responderán del mismo modo. En este momento, adoptar un enfoque más cauteloso y considerado de la IA en las operaciones y hacer preguntas a los vendedores y proveedores es la opción correcta para los gestores de riesgos de terceros.

Para obtener más información sobre cómo Mitratech incorpora tecnologías de IA en nuestras soluciones de gestión de riesgos de terceros para garantizar la transparencia, la gobernanza y la seguridad, descargue el libro blanco Cómo aprovechar el poder de la IA en la gestión de riesgos de terceros o solicite una demostración hoy mismo.

Nota del editor: Este artículo se publicó originalmente en Prevalent.net. En octubre de 2024, Mitratech adquirió la empresa de gestión de riesgos de terceros basada en IA, Prevalent. El contenido ha sido actualizado desde entonces para incluir información alineada con nuestra oferta de productos, cambios regulatorios y cumplimiento.